Gesichtserkennung und KI-Überwachung breiten sich rasant aus, von Flughäfen über Spitäler bis hin zu Smart Citys und persönlichen Geräten. Während diese Hilfsmittel mehr Sicherheit und Effizienz versprechen, führen sie auch zu grossen Bedenken in Bezug auf Datenschutz, Zustimmung und algorithmischen Bias. CSEM-Forschende haben nun eine bahnbrechende Lösung entwickelt: eine KI-Trainingsmethode, die komplexe Überwachungsaufgaben ausführt und dabei persönliche Merkmale wie Gesichter, Geschlecht oder Alter unwiderruflich aus ihrem Speicher löscht.

CSEM hat eine leistungsstarke neue KI-Trainingsmethode entwickelt, die eine Überwachung der Bevölkerung (zum Beispiel in öffentlichen Räumen oder Spitälern) ermöglicht und gleichzeitig die persönliche Privatsphäre schützt und einem Bias vorbeugt. Die Methode nutzt eine «Adversarial Training»-Strategie, die in der Trainingsphase der KI ein sogenanntes «Watchdog»-Netzwerk einführt. Dieser interne Herausforderer erkennt, wenn das System versucht, Informationen zu speichern, die es nicht sollte (zum Beispiel das Alter einer Person), und zwingt es, sie zu vergessen. Das Resultat: KI, die immer noch Massenströme überwachen, Gesundheitsanomalien erkennen oder Zugriffskontrollen unterstützen kann – ohne jemals zu erfassen, wer Sie sind.

«Mit dieser Technologie beweisen wir, dass ethische, datenschutzorientierte KI nicht nur möglich, sondern auch praktisch ist».

Nadim Maamari, Group Leader beim CSEM

Leistung und Schutz – keine Kompromisse erforderlich

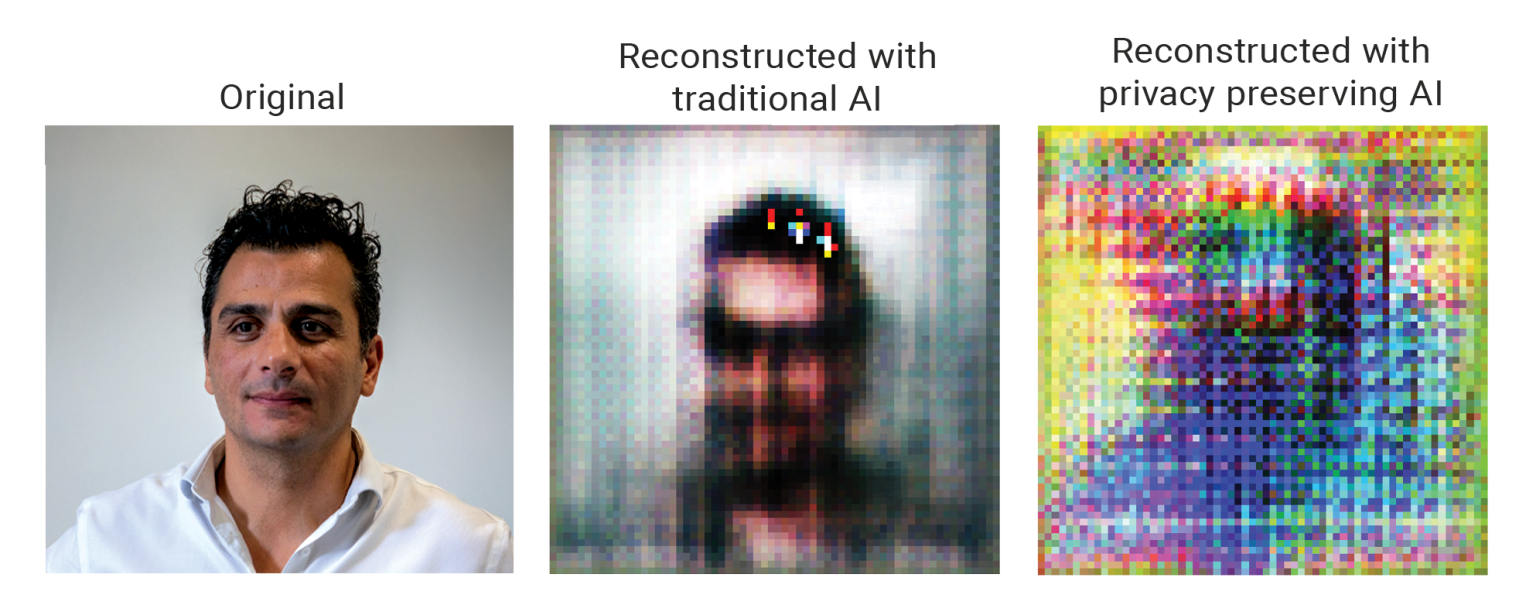

Die Innovation, welche die CSEM-Gruppe «Edge AI and Vision Systems» entwickelte, wurde sowohl mit medizinischen Daten als auch mit Gesichtsbildern getestet. Es zeigte sich, dass Modelle, die mit der datenschutzorientierten Methode trainiert wurden, noch besser abschneiden als herkömmliche KI-Systeme; die Task-Genauigkeit wurde um bis zu 6,7 Prozent verbessert. Zudem erwies sich das System als widerstandsfähig gegen fortgeschrittene Angriffe auf die Privatsphäre, einschliesslich der Versuche, Gesichter aus Modellparametern rückzuentwickeln.

Diese Ergebnisse wurden kürzlich auf der 22. Internationalen Konferenz über verteiltes Rechnen und Künstliche Intelligenz (22nd International Conference on Distributed Computing and Artificial Intelligence, DCAI) in Frankreich vorgestellt.

Kurzum: Es dürfen keine sensiblen Daten vom System gespeichert, übertragen oder gar eingesehen werden. Dieser Ansatz ermöglicht sichere KI-Einsätze in Bereichen wie Gesundheitswesen, öffentliche Sicherheit, urbane Mobilität und Unterhaltungselektronik.

Globale Relevanz der Gesichtserkennungstechnologie

Die Technologie der Gesichtserkennung schreitet rasch voran. Systeme wie Deep Face von Meta entsprechen jetzt der menschlichen Genauigkeit. Im Jahr 2024 scannte die britische Polizei über 4,7 Millionen Gesichter mittels Live-Gesichtserkennung, was zu Hunderten von Festnahmen beitrug. Eine Umfrage in den USA im Jahr 2020 ergab, dass 66 Prozent der Befragten Gesichtserkennung in der Strafverfolgung unterstützen.

Dennoch bestehen immer noch grosse Bedenken. Die Genauigkeit variiert nach wie vor stark je nach Bevölkerungsgruppe, wobei die Fehlerquote bei stärker dunkelhäutigen Frauen bei bis zu 34,7 Prozent im Vergleich zu 0,8 Prozent bei hellhäutigen Männern liegt. Das öffentliche Vertrauen ist gespalten, vor allem wenn kommerzielle oder staatliche Akteure beteiligt sind.

Regierungen weltweit reagieren. China hat Transparenz- und Zustimmungsregeln eingeführt. Die EU bringt ihr KI-Gesetz zum Abschluss. Die Schweiz verfolgt derweil einen sektoralen Ansatz und integriert KI-Aufsicht in bestehende Rechtsstrukturen.

Schweiz: Verschärfte Regulierung, Innovation als Antwort

Das revidierte Schweizer Datenschutzgesetz (DSG), das seit September 2023 in Kraft ist, stuft biometrische Daten als streng vertraulich ein. Wie der Eidgenössische Datenschutz- und Öffentlichkeitsbeauftragte bestätigte, ist die grossflächige Echtzeit-Gesichtserkennung im öffentlichen Raum ohne spezifische gesetzliche Begründung faktisch verboten.

In einer Petition aus dem Jahr 2021 verlangten die Schweizerinnen und Schweizer ein nationales Verbot der überwachungsbasierten Gesichtserkennung, und 80 Prozent der Kandidierenden fürs Parlament sprachen sich 2023 für strengere Kontrollen aus. Auch die kantonalen Initiativen schreiten voran: Neuenburg hat die «digitale Integrität» in seiner Verfassung verankert; St. Gallen steuert die E-Signatur an und Lausanne treibt die Reform der E-Governance voran.

Die datenschutzorientierte KI von CSEM ist auf den Einsatz in der realen Welt ausgelegt

Die CSEM-Methode unterstützt diesen regulatorischen Rahmen, indem sie sicherstellt, dass KI niemals sensible personenbezogene Daten speichert oder verarbeitet, was die Risiken von Missbrauch, Profiling und Angriffen auf die Privatsphäre mindert. Die Technologie ist kompakt, energieeffizient und ideal für den Einsatz in eingebetteten Systemen. Sie stellt sicher, dass KI-Systeme nur das lernen, was sie für ihre Aufgabe benötigen. Es müssen keine privaten Daten gespeichert oder weitergegeben werden.

Das System «verlernt» aktiv, wer Sie sind, und konzentriert sich nur auf das Wesentliche, wodurch es für verantwortungsvolle Anwendungen in den Bereichen Gesundheit, Sicherheit und öffentliche Dienste ideal geeignet ist. Die Technologie ist heute getestet, betriebs- und einsatzbereit.